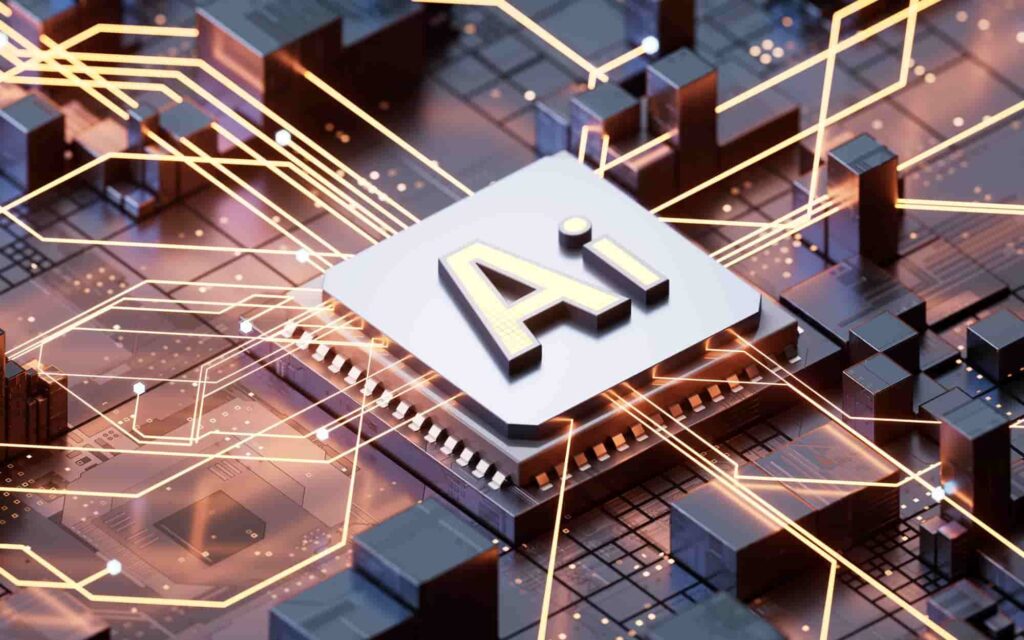

בשנים האחרונות, הבינה המלאכותית (AI) חוללה מהפכה בתעשיות רבות, והעולם המשפטי אינו יוצא דופן. לפי דו"ח של חברת המחקר Gartner, עד שנת 2025 כ-75% ממשרדי עורכי הדין יאמצו מערכות בינה מלאכותית לביצוע משימות משפטיות שונות, כגון סקירת מסמכים, חיזוי תוצאות משפטיות וניסוח חוזים. כבר כיום, יותר מ-35% מהחברות המשפטיות המובילות בעולם משתמשות בטכנולוגיות AI לשיפור היעילות, חיסכון בעלויות והפחתת עומס העבודה על עורכי הדין. אך לצד היתרונות הברורים, השימוש בבינה מלאכותית מעלה סוגיות משפטיות מורכבות, כגון אחריות על החלטות אלגוריתמיות, פגיעה בפרטיות ואובדן האתיקה המקצועית.

יתרון מרכזי של הבינה המלאכותית בתחום המשפט הוא יכולתה לעבד כמויות עצומות של מידע במהירות ובדיוק רב. למשל, תוכנות ניתוח משפטי מבוססות AI מסוגלות לעבור על מיליוני מסמכים משפטיים בתוך דקות ספורות – משימה שהייתה אורכת לצוות עורכי דין שבועות ואף חודשים. בנוסף, מחקרים מראים כי כלים אלו משפרים את דיוק החיזוי המשפטי בכ-20% בהשוואה לניתוח אנושי בלבד. יחד עם זאת, אלגוריתמים משפטיים אינם חסינים מטעויות או מהטיות, והחלטות שמתקבלות על בסיס AI עשויות להיות מושפעות מנתונים חסרים או מוטים, דבר שעלול לגרום להחלטות בלתי הוגנות ואף שגויות מבחינה משפטית.

מן הצד השני, השימוש הגובר בבינה מלאכותית מעלה שאלות אתיות ומשפטיות כבדות משקל. לדוגמה, אם תוכנה משפטית מבוססת AI מספקת ייעוץ שגוי, מי נושא באחריות? האם מדובר ברשלנות מקצועית מצד עורך הדין שהסתמך על המערכת, או שמא יש להטיל אחריות על יצרן התוכנה? בנוסף, סוגיות של פרטיות ורגולציה הופכות להיות קריטיות, במיוחד כאשר מערכות AI נדרשות לנתח מידע רגיש של לקוחות. על אף שקיימות תקנות, נכון להיום אין מסגרת משפטית אחידה וברורה שמסדירה את השימוש בבינה מלאכותית בעולם המשפט, מה שמשאיר תחום זה בגדר "שטח אפור" המחייב בחינה מעמיקה והתאמות רגולטוריות דחופות.

האם בינה מלאכותית יכולה להחליף שופטים?

השימוש בבינה מלאכותית במערכת המשפט מעורר דיון עקרוני לגבי תפקידה בקבלת החלטות שיפוטיות. כיום, מערכות אוטומציה משפטית כבר משמשות ככלים תומכים לשופטים, בין אם בניתוח מסמכים, זיהוי תקדימים או חיזוי תוצאות משפטיות. יש הטוענים כי ככל שהטכנולוגיה תתפתח, ניתן יהיה להרחיב את השימוש בבינה מלאכותית גם לקבלת החלטות עצמאיות בתיקים פשוטים, מה שעשוי לצמצם עומסים בבתי המשפט ולייעל את הטיפול בתיקים. מנגד, קיימת מחלוקת לגבי גבולות האחריות המשפטית של מערכות אלו והיכולת שלהן לשקלל גורמים אנושיים מורכבים כמו שיקול דעת, מוסר וצדק מהותי.

| במערכת המשפט המודרנית, בינה מלאכותית (AI) משולבת ככלי תומך בהחלטות שיפוטיות, במיוחד בניתוח מסמכים, זיהוי תקדימים וחיזוי תוצאות משפטיות. לדוגמה, בסין פועלת מערכת בשם "סייען השופט החכם" (Smart Court Assistant) ביותר מ-100 בתי משפט, המסייעת בניתוח חומרים משפטיים, הערכת ראיות והצעת טיוטות פסיקה. בישראל, הנהלת בתי המשפט בוחנת הטמעת מערכות AI לשיפור היעילות וקיצור ההליכים המשפטיים. מנהל בתי המשפט, לפי ידיעה בישראל היום השופט מיכאל שפיצר, נפגש עם מומחה בתחום לדון באפשרות זו, תוך הדגשה שמערכות אלו לא יחליפו את שיקול הדעת השיפוטי האנושי. |

למרות הדיוק והמהירות של מערכת אוטומציה, ההשלכות המשפטיות של הטמעתה כשופט עצמאי מחייבות בחינה מעמיקה. ההסתמכות על אלגוריתמים מעלה שאלות בנוגע להטיות אפשריות, שקיפות תהליכי קבלת ההחלטות והיכולת לערער על פסקי דין שניתנו על ידי מערכת שאינה אנושית. יתרה מכך, יש לשקול את השפעת פיתוח אוטומציה משפטית על אמון הציבור במערכת המשפט. שימוש בטכנולוגיה עשוי ליצור תחושה של הליך קר ומנוכר, שאינו מביא בחשבון היבטים אישיים ורגשיים של הצדדים המעורבים.

מערכת המשפט לא נועדה להיות רק מנגנון טכני להכרעת סכסוכים, אלא גם מוסד שמגלם ערכים חברתיים. גם אם שירותי אוטומציה יכולים לשמש כלי עזר יעיל, ההחלטות השיפוטיות צריכות להישאר בידי בני אדם, לפחות בתיקים מורכבים המחייבים רגישות והבנה מעמיקה של ההקשרים הרחבים. השאלה אם ניתן להפקיד את גורל המתדיינים בידי מערכת אוטומטית נותרת פתוחה, וכנראה שהתשובה טמונה באיזון שבין טכנולוגיה לשיקול דעת אנושי.

השפעת הבינה המלאכותית על חיסיון עורך דין לקוח

ההתפתחות המהירה של בינה מלאכותית בתחום המשפט מעלה שאלות משמעותיות לגבי שמירה על חיסיון עורך דין לקוח. משרדי עורכי דין משתמשים בטכנולוגיות מתקדמות כמו מערכות לניתוח מסמכים, עיבוד נתונים משפטיים וחיזוי תוצאות הליכים משפטיים. עם זאת, כאשר מידע רגיש מוזן לתוך מערכות אלו, עלול להיווצר סיכון ממשי לפגיעה בחיסיון עו"ד לקוח, במיוחד אם הנתונים מועברים לענן או נחשפים לצדדים שלישיים.

למרות שהמסגרת המשפטית מחייבת הגנה על חיסיון עורך דין, אין כיום רגולציה מסודרת הקובעת כיצד ניתן להשתמש בבינה מלאכותית מבלי להפר את כללי החיסיון. אם מערכת בינה מלאכותית אוספת ומנתחת מידע חסוי, קיים חשש שהמידע ייחשף בטעות או ינוצל לרעה, מה שעשוי להוביל לערעור אמון הלקוחות בעורכי דינם. בנוסף, עולה השאלה מי נושא באחריות במקרה של דליפת מידע – עורך הדין, ספק הטכנולוגיה או מפתחי המערכת.

כדי להבטיח כי חיסיון עורך דין לקוח יישמר גם בעידן הבינה המלאכותית, על משרדי עורכי דין לנקוט משנה זהירות בשימוש במערכות מבוססות AI. מומלץ לבחור בפלטפורמות מאובטחות, להגביל את המידע המוזן לאלגוריתמים ולוודא שהשירותים המשפטיים שהם משתמשים בהם עומדים בדרישות האתיות והמשפטיות המחמירות ביותר. ללא הגנה מספקת, הטכנולוגיה שאמורה להקל על העבודה המשפטית עלולה להפוך לגורם סיכון משמעותי

שימוש בבינה מלאכותית בניסוח חוזים – יתרונות וסיכונים

השימוש בבינה מלאכותית בניסוח חוזים מציע יתרונות רבים לצד סיכונים משמעותיים. מצד אחד, AI מאפשר יצירת חוזה במהירות וביעילות, תוך שימוש במודלים המבוססים על מאגרי מידע משפטיים נרחבים. יתרון ברור הוא היכולת להפחית טעויות אנוש ולשפר את הדיוק בניסוח סעיפים מורכבים. עם זאת, קיים סיכון שהמערכת לא תבין הקשרים משפטיים עדינים, מה שעלול להוביל לבעיות משפטיות בעת יישום ההסכם. בנוסף, שימוש במערכות חיצוניות מעלה חששות בנוגע לחיסיון המידע ולמידת האחריות במקרה של פגם או פרשנות שגויה של חוזה שנוסח על ידי AI.

הטבלה שלפניכם מציגה את היתרונות והחסרונות של שימוש בבינה מלאכותית בניסוח חוזים. מצד אחד, AI מאפשר ניסוח מהיר ומדויק, מפחית טעויות אנוש ומוזיל עלויות. מצד שני, הוא עלול להחמיץ ניואנסים משפטיים, להוות סיכון לפרטיות ולהעלות שאלות לגבי אחריות משפטית. הטבלה מספקת מבט מאוזן על האופן שבו הטכנולוגיה הזו משפיעה על התחום המשפטי.

| יתרונות | חסרונות |

|---|---|

| מהירות ויעילות – AI יכול לנסח חוזים במהירות ולחסוך זמן עבודה. | היעדר שיקול דעת אנושי – AI עשוי לא להבין הקשרים משפטיים מורכבים. |

| הפחתת טעויות אנוש – המערכת מזהה שגיאות בניסוח משפטי. | חשש לפרצות אבטחה – שימוש במערכות חיצוניות עלול לחשוף מידע רגיש. |

| נגישות למאגרים משפטיים – AI מנתח חוזים קודמים להצעת ניסוחים מיטביים. | סיכון משפטי ואחריות – אם החוזה פגום, לא תמיד ברור מי אחראי. |

| התאמה אישית ואוטומציה – ניתן להתאים חוזים במהירות ללקוח. | |

| עלויות נמוכות יותר – חוסך שעות עבודה ועלויות ניסוח. |

האחריות המשפטית על טעויות של בינה מלאכותית – מי אחראי?

האחריות המשפטית על טעויות בינה מלאכותית היא נושא מורכב שמעלה שאלות עקרוניות במערכת המשפט. כאשר מערכות כמו ChatGPT, Claude או כלים אחרים של OpenAI יוצרות תוכן משפטי, מספקות תמלול או מנתחות מסמכים, קיים סיכון לטעויות או לעיוותים במידע. לעיתים, המערכות מייצרות הזיות – מונח המתאר מצבים שבהם הבינה המלאכותית ממציאה עובדות או מסיקה מסקנות שגויות. במקרים בהם משתמשים מסתמכים על מידע זה לקבלת החלטות משפטיות או עסקיות, עשויה להתעורר השאלה מי נושא באחריות המשפטית במקרה של נזק.

כיום, אין מסגרת חוקית אחידה שמגדירה באופן ברור מי אחראי לטעויות שנובעות מבינה מלאכותית. מצד אחד, ניתן לטעון כי האחריות מוטלת על המשתמשים, מאחר שהם אלו שבוחרים להסתמך על התוכן שהמערכת מספקת. מצד שני, ישנה טענה כי החברות המפתחות, כמו OpenAI, מחויבות לוודא שמוצריהן פועלים באופן מדויק ומוגן מפני שגיאות חמורות. כמו כן, אם גורם שלישי, כגון עורך דין, עושה שימוש במידע שנוצר על ידי ChatGPT או Claude, מתעוררת השאלה האם הוא אחראי לבדוק את נכונות הנתונים לפני השימוש בהם.

היעדר חקיקה ברורה יוצר חוסר ודאות משפטית, ולכן יש צורך בפיתוח כללים מחייבים שיגדירו את תחומי האחריות של המשתמשים, המפתחים והגופים המפקחים. פתרונות אפשריים עשויים לכלול רגולציה מחייבת שתטיל חובות על ספקי תוכן מבוסס AI, חיוב המשתמשים להצהיר על השימוש בבינה מלאכותית במסמכים משפטיים, או יצירת מנגנוני בקרת איכות מתקדמים שיצמצמו את שיעור הטעויות. עד שיוגדרו כללים ברורים, השימוש בבינה מלאכותית בתחום המשפט נותר בגדר כלי עזר חשוב, אך כזה המחייב זהירות ובחינה מדוקדקת לפני הסתמכות מלאה.

זכויות יוצרים ו- AI – מתי האלגוריתם הופך ליוצר?

בשנת 2023, יצירה בשם "Théâtre D’opéra Spatial" שנוצרה על ידי בינה מלאכותית זכתה במקום הראשון בתחרות אמנות דיגיטלית, אך עד מהרה פרץ דיון סוער – האם מגיעות לה זכויות יוצרים? האם המשתמש שהזין את ההנחיות הוא היוצר, או שמא הזכויות שייכות לחברה שפיתחה את האלגוריתם? המקרה עורר עניין בקרב עורכי דין בתחום קניין רוחני, שכן חוק זכויות יוצרים המסורתי לא התמודד בעבר עם שאלה כזו.

לא מדובר במקרה בודד. גם בתחום המוזיקה, תמונות וסרטונים, מערכות AI כמו DALL·E ו-Google DeepDream יוצרות יצירות חדשות, וחברות רבות טוענות לבעלות על התוכן. בארצות הברית, בית המשפט פסק כי מאגר תמונות שנוצר במלואו על ידי בינה מלאכותית אינו זכאי לרישום זכויות יוצרים, מאחר שאין בו "יצירתיות אנושית". בישראל, טרם נקבעה הלכה מחייבת בנושא, אך עורכי דין מזהירים כי שימוש לא מפוקח בתוכן מבוסס AI עלול להוביל לתביעה בגין הפרת זכויות יוצרים, במיוחד כאשר נעשה שימוש בתכנים מוגנים כמו לוגו, עיצוב גרפי או חומרים של דיסני.

המציאות המשפטית עדיין מתגבשת (נכון ל 2025), אך ברור שהשימוש הגובר בAI מציב אתגר לדיני זכויות יוצרים. פלטפורמות כמו פייסבוק, אינסטגרם ויוטיוב כבר החלו להחמיר את הכללים לגבי שימוש הוגן, ועסקים רבים מחפשים ייעוץ משפטי כדי להבין כיצד להגן על הסכם או חוזה זכויות יוצרים בעולם שבו הפרת זכויות יוצרים עשויה להתרחש בלחיצת כפתור.

רגולציה בתחום הבינה המלאכותית

הרגולציה בתחום הבינה המלאכותית מתקשה להדביק את קצב ההתפתחות הטכנולוגית, מה שיוצר אתגרים משפטיים מורכבים. אחד הנושאים הבולטים הוא זכויות יוצרים בתוכן דיגיטלי, כאשר תוכנות מבוססות AI מסוגלות לייצר טקסטים, תמונות וסרטונים שלמים באופן אוטומטי. החקיקה הקיימת אינה מספקת מענה ברור לשאלה מי הבעלים החוקי של יצירה שנוצרה על ידי אלגוריתם – האם מדובר במפתחי התוכנה, המשתמשים שהזינו את הנתונים, או שהיצירה כלל אינה יכולה להיות מוגנת בזכויות יוצרים.

נושא נוסף שמעלה את הצורך ברגולציה דחופה הוא תביעות דיפ פייק. טכנולוגיית הDeepfake מאפשרת יצירת סרטונים מזויפים באיכות גבוהה, מה שעלול לשמש למטרות הונאה, פגיעה בפרטיות והפצת מידע כוזב. במדינות שונות כבר הוגשו תביעות דיפ פייק, במיוחד במקרים שבהם נעשה שימוש לרעה בזהותם של פוליטיקאים, ידוענים ואנשים פרטיים. עם זאת, מרבית המדינות טרם גיבשו חוקים מחייבים להתמודדות עם התופעה, והשאלה מי נושא באחריות – יוצר התוכן, מפיץ הסרטון או מפתח הטכנולוגיה – נותרת פתוחה.

למרות הניסיונות לעדכן את החקיקה, ברור כי הפער בין התקדמות הבינה המלאכותית לבין הרגולציה הולך וגדל. בעוד שחקיקות מסוימות באירופה ובארצות הברית מתחילות להסדיר את השימוש בטכנולוגיה זו, רוב המדינות עדיין אינן ערוכות להתמודד עם השפעותיה. כדי להגן על זכויות הפרט, למנוע הפרות זכויות יוצרים בתוכן דיגיטלי ולהבטיח שימוש הוגן באלגוריתמים חכמים, יש צורך בחקיקה גלובלית ברורה שתגדיר גבולות אתיים ומשפטיים לשימוש בAI.